Bambusowe lotniska, czyli „cargo cult science” w SEO – felieton

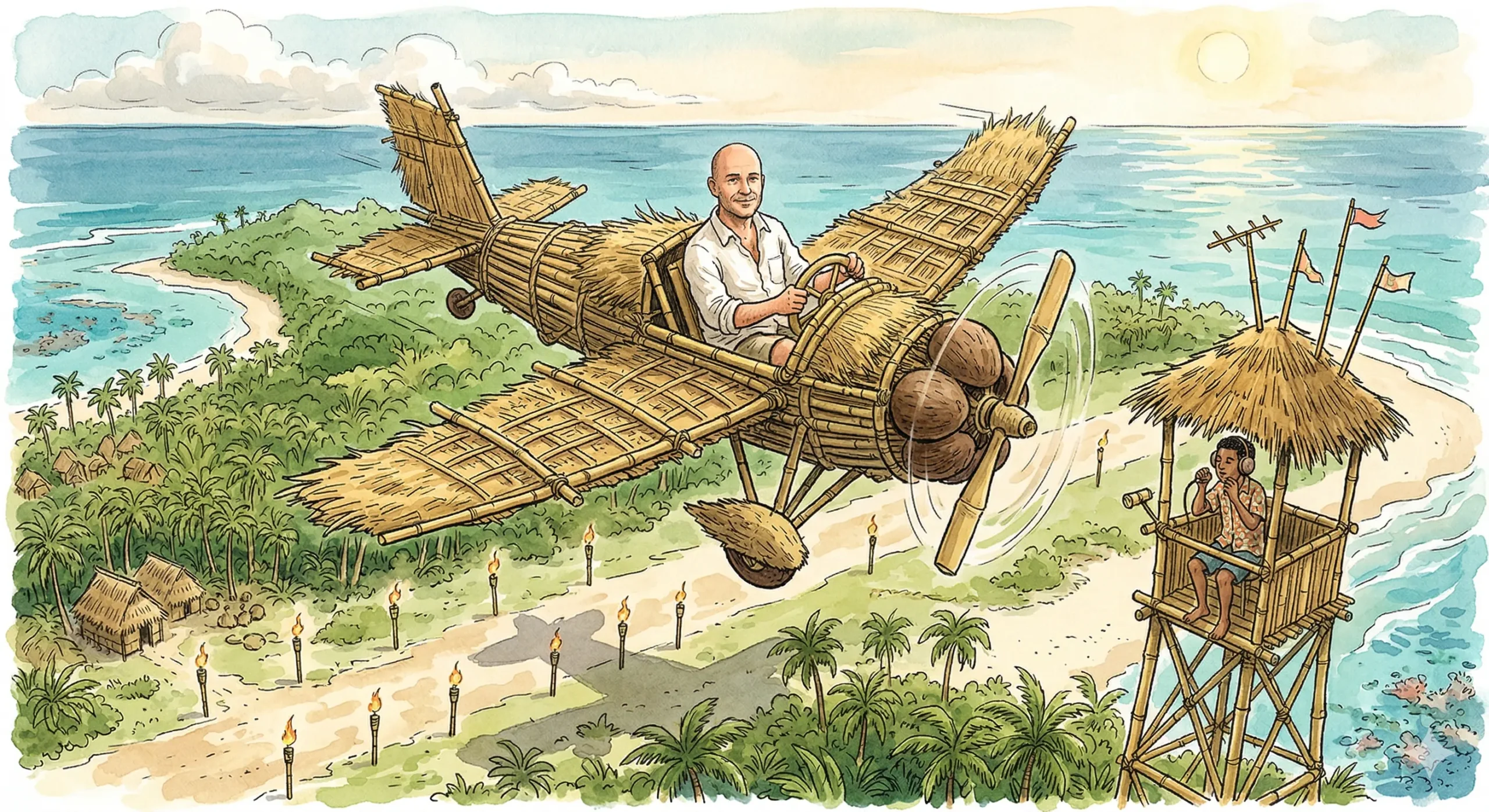

W 1974 roku Richard Feynman wygłosił przemówienie do absolwentów Caltech. Opowiedział w nim o wyspach Melanezji po drugiej wojnie światowej. Przez kilka lat lądowały tam amerykańskie samoloty z zaopatrzeniem. Kiedy wojna się skończyła i Amerykanie odeszli, wyspiarze chcieli, żeby samoloty wróciły. Zbudowali z bambusa i słomy coś, co wyglądało jak pasy startowe. Postawili drewniane wieże kontrolne. Zrobili słuchawki z kokosów. Siadali w tych wieżach i czekali.

Samoloty nie przyleciały.

Feynman użył tej historii jako metafory pewnego typu badań. Takich, które mają formę nauki — dane, metodologię, wykresy, cytowania — ale pomijają to, co on nazywał „utter scientific integrity”. Bezwzględną uczciwość wobec własnych wyników. Aktywne szukanie dziur we własnych wnioskach. Raportowanie tego, co może podważyć tezę, a nie tylko tego, co ją wspiera.

Od kilkunastu lat obserwuję, jak branża SEO buduje własne bambusowe lotniska.

Cztery warstwy problemu

Zacznijmy od statystyki, bo tu jest fundament.

Typowa „duża analiza SEO” bierze kilkaset, kilka tysięcy, a widziałem już miliony stron i mierzy na nich dziesiątki i setki zmiennych. Długość tekstu, liczba nagłówków H2, obecność schema markup, Core Web Vitals, liczba linków wewnętrznych, gęstość słów kluczowych, encje, semantyka itd. A potem szuka korelacji z pozycjami w Google.

Problem w tym, że gdy testujesz wiele zmiennych jednocześnie, losowe korelacje są nieuniknione. To się nazywa problem wielokrotnych porównań (ang. multiple comparisons problem). Przy standardowym progu istotności statystycznej p < 0,05, testując 1000 zmiennych, około 50 da wynik „statystycznie istotny” czysto przypadkowo. Pięćdziesiąt fałszywych odkryć. Bez żadnego sygnału w danych.

Istnieją metody korekty np. Bonferroni, Benjamini-Hochberg. Nie widziałem, żeby którakolwiek z dużych branżowych analiz SEO je stosowała. Może stosują i nie piszą o tym. Ale wtedy większość ich efektownych wniosków zniknęłaby.

Warstwa druga: survivorship bias. Te analizy badają strony, które już rankują. Wyciągają wnioski wstecz – co te strony mają wspólnego, co „zadziałało”. Nikt nie pokazuje tysięcy stron, które miały identyczne cechy i nie weszły do top 10. Bo tych stron nie ma w datasecie. Nie rankują, więc nie istnieją w analizie.

To tak, jakbyś badał milionerów i stwierdził, że 80% z nich wstaje przed szóstą rano. Wniosek: wczesne wstawanie prowadzi do bogactwa. Tyle że nie sprawdziłeś, ilu ludzi wstaje przed szóstą i nie jest milionerami. A są ich miliony.

Warstwa trzecia: nieweryfikowalne założenia. Tutaj wchodzą patenty Google. Firma patentuje tysiące pomysłów rocznie, głównie defensywnie – żeby konkurencja nie mogła zablokować ewentualnych wdrożeń. Opatentowany koncept może nigdy nie trafić do algorytmu. Może trafić w zmienionej formie. Może trafił i został wycofany pięć lat temu.

Ktoś bierze patent o „entity salience scoring”, robi z tego prezentację na Brighton SEO, i nagle pół branży optymalizuje pod mechanizm, który może nie istnieć w produkcyjnym kodzie. To jest odwrócona inżynieria czegoś, co prawdopodobnie nigdy nie zostało zbudowane.

Warstwa czwarta dołączyła w ostatnich dwóch latach: niestabilny obiekt pomiaru. W erze AI wynik wyszukiwania to proces probabilistyczny. Ten sam prompt przy temperaturze > 0 generuje różne odpowiedzi. Twoja marka może pojawić się w AI o 14:00, a pięć minut później już nie.

Agencja, która „monitoruje widoczność w AI”, zbiera pojedyncze próbki z tego procesu i wyciąga z nich wnioski. Nie zna rozkładu prawdopodobieństwa. Nie wie, ile razy odpowiedź się zmienia między jej pomiarami. A mimo to dostarcza dashboard z wykresem „twoja widoczność w AI rośnie o 12%”. To jest mierzenie z dokładnością do dwóch miejsc po przecinku czegoś, czego margines błędu wynosi plus minus pięćdziesiąt procent.

Każda z tych warstw osobno obniża wiarygodność wniosków. Razem tworzą coś, co wygląda jak analiza, ale nią nie jest.

Jak to się sprzedaje

Opasły raport działa na kilku poziomach.

Pierwszy to objętość jako substytut wartości. Klient dostaje 80-stronicowy PDF z wykresami, heatmapami, tabelami porównawczymi. Trudno powiedzieć „zapłaciłem 30 tysięcy za dwie strony wniosków”, nawet jeśli te dwie strony byłyby dokładnie tym, czego potrzebuje. 80 stron waży. Czuć, że ktoś pracował.

Drugi to duża liczba w nagłówku. „Przeanalizowaliśmy 47 czynników rankingowych na 10 000 stronach”. Samo zdanie budzi respekt. Mało kto pyta: jaką zastosowaliście korektę na wielokrotne porównania? Jaki był rozmiar efektu? Czy kontrolowaliście zmienne zakłócające?

Trzeci to wizualna perswazja. Heatmapa wygląda naukowo niezależnie od tego, co przedstawia. Wykres z linią trendu sugeruje związek przyczynowy nawet wtedy, gdy korelacja jest losowa. Dashboard z liczbami odświeżanymi w czasie rzeczywistym daje poczucie kontroli nad czymś, co z natury jest nieprzewidywalne.

Czwarty to język pewności. „Nasze dane jasno pokazują” brzmi lepiej niż „zaobserwowaliśmy korelację, która może być przypadkowa”. Ale to drugie sformułowanie jest uczciwe, a pierwsze nie.

Dlaczego klienci na to reagują

Tu nie chodzi o naiwność. Mechanizmy psychologiczne, które za tym stoją, działają na wszystkich.

Authority bias sprawia, że osoba prezentująca dane z wykresami automatycznie zyskuje wiarygodność. Szczególnie wtedy, gdy klient nie ma kompetencji, żeby dane zweryfikować. A w SEO większość klientów ich nie ma – dlatego w ogóle szukają pomocy.

Complexity bias – skomplikowane wyjaśnienie brzmi bardziej wiarygodnie niż proste. „Optymalizujemy entity salience w kontekście knowledge graph topology” brzmi mądrzej niż „poprawiamy treść stron i linkowanie wewnętrzne”. Nawet jeśli to drugie da lepsze efekty.

Redukcja niepewności – SEO jest z natury nieprzewidywalne. Klient nie rozumie algorytmu i to go niepokoi. 80-stronicowy raport daje iluzję, że ktoś rozumie. Że chaos został uporządkowany. Że jest plan oparty na danych. Ta iluzja ma realną wartość psychologiczną, nawet jeśli nie ma wartości merytorycznej.

Efekt zakotwiczenia – raz pokazane liczby (pozycje, widoczność, prognozowany ruch) stają się punktem odniesienia. Klient zaczyna myśleć w kategoriach tych liczb, nawet jeśli sposób ich wyliczenia jest wątpliwy.

Sunk cost – po zapłaceniu za analizę łatwiej wierzyć w jej wnioski niż przyznać, że pieniądze poszły na coś bezwartościowego. Im droższa analiza, tym silniejszy ten efekt.

Nie tylko SEO

Branża SEO nie jest w tym wyjątkowa. Ten sam wzorzec pojawia się wszędzie tam, gdzie weryfikacja jest trudna, a zapotrzebowanie na pewność duże.

Dietetyka zmienia wroga publicznego co dekadę. W latach 90. tłuszcz był zły, potem cukier, potem gluten, potem lektyny. Każda zmiana podparta „badaniami” opartymi na tych samych błędach metodologicznych – małe próby, brak kontroli zmiennych, korelacja traktowana jak przyczynowość.

Philip Tetlock przebadał 28 000 prognoz ekspertów ekonomicznych w ciągu 20 lat. Wynik: eksperci prognozowali gorzej niż prosta ekstrapolacja trendów. Ich modele były bardziej skomplikowane, ich pewność siebie wyższa, a trafność niższa.

W psychologii kryzys replikacji po 2011 roku pokazał, że wiele kanonicznych odkryć – efekt primingu, ego depletion, power posing – nie powtarza się w nowych badaniach. Forma naukowa była zachowana. Próbki były za małe, a p-hacking (manipulowanie analizą aż wynik wyjdzie „istotny”) masowy.

Consulting korporacyjny McKinsey, BCG, Bain produkują raporty z frameworkami i matrycami 2×2. Wartość predykcyjna tych analiz jest znikoma. Kupujesz pewność siebie prezentującego, nie trafność prognoz.

Wspólny mianownik: im trudniejszy do zmierzenia jest prawdziwy mechanizm przyczynowy, tym bardziej rozrasta się aparat analityczny wokół niego. W inżynierii mostów cargo cult science eliminuje się szybko, bo most się zawali. W SEO, dietetyce czy prognozowaniu rynków – feedback loop jest tak długi i tak zaszumiony, że błędne wnioski mogą żyć latami.

Problem zepsutego zegara

Zepsuty zegar pokazuje prawidłową godzinę dwa razy na dobę. Część wniosków z tych dużych analiz z dużym prawdopodobieństwem jest trafna. Przy tysiącach zmiennych i setkach korelacji część musi trafić w coś prawdziwego – to statystyczna nieuchronność. Problem polega na czymś innym: nie wiesz, która część.

Masz 50 wniosków. Powiedzmy, że 8 z nich opisuje realne zależności w algorytmie. Pozostałe 42 to szum statystyczny albo korelacja bez przyczynowości. Ale te 8 trafnych wniosków wygląda w raporcie dokładnie tak samo, jak tamte 42. Nie są pogrubione. Nie świecą na zielono. Nic ich nie odróżnia.

W naukach eksperymentalnych ten problem rozwiązujesz replikacją – powtarzasz badanie na nowej próbie i sprawdzasz, czy efekt się utrzymuje. W SEO replikacja jest praktycznie niemożliwa. Algorytm Google zmienia się w trakcie badania. Nie masz grupy kontrolnej. Nie możesz odizolować zmiennych, bo wszystko działa jednocześnie. Nawet gdybyś powtórzył analizę na innym zestawie stron miesiąc później, wynik mógłby być inny nie dlatego, że wniosek był fałszywy, ale dlatego, że Google zdążył w międzyczasie wdrożyć aktualizację.

Do tego dochodzą biasy po stronie osób prowadzących analizę.

Confirmation bias – badacz podświadomie szuka potwierdzenia tego, w co już wierzy. Jeśli jest przekonany, że długość tekstu ma znaczenie, znajdzie korelację. Albo będzie szukał tak długo, aż ją znajdzie, odrzucając po drodze zmienne, które nie pasowały do tezy.

Bias publikacyjny – nikt nie publikuje artykułu „zbadaliśmy 200 zmiennych i nic nie znaleźliśmy”. Takie badanie nie trafi na scenę konferencji, nie wygeneruje leada, nie zbuduje marki. Publikowane są wyniki efektowne, zaskakujące, sprzeczne z intuicją. A to dokładnie te, które mają najwyższe prawdopodobieństwo bycia fałszywymi.

Narzędziowy bias – analizujesz to, co umiesz mierzyć, a nie to, co ma znaczenie. Narzędzia SEO dają ci dane o meta tagach, strukturze nagłówków, prędkości ładowania. Nie dają ci danych o tym, czy użytkownik znalazł to, czego szukał. Więc optymalizujesz pod to, co widać w dashboardzie, i zakładasz, że to jest to, co liczy algorytm.

Efekt końcowy: raport może zawierać trafne obserwacje. Tyle że nie ma sposobu, żeby je oddzielić od szumu, a wszystkie są prezentowane z tym samym poziomem pewności. To gorsza sytuacja niż brak danych – bo brak danych przynajmniej nie daje fałszywego poczucia, że wiesz.

Co w takim razie ma wartość

Żeby ten artykuł nie zostawił po sobie tylko pogorzeliska, kilka słów o tym, co faktycznie działa inaczej.

Zależności mechanistyczne dają się weryfikować. Googlebot nie renderuje twojej strony – widzisz to w logach serwera. Canonical wskazuje na złą wersję – to fakt, nie korelacja. Strona zwraca soft 404 – masz kod odpowiedzi, możesz to potwierdzić. Techniczne SEO operuje na warstwie, w której przyczynowość jest obserwowalna.

Dobry raport zawiera rozdział, którego złe raporty nie mają: „dlaczego możemy się mylić”. Jeśli analiza nie podaje warunków, pod którymi jej wnioski byłyby fałszywe, to nie jest analiza. To reklama.

Wąskie pytania dają lepsze odpowiedzi niż szerokie. „Dlaczego ta kategoria straciła 40% ruchu po migracji” jest lepszym punktem wyjścia niż „zoptymalizujcie nam stronę na podstawie 47 czynników”. Mniej zmiennych, więcej głębokości. Mniej bambusa, więcej betonu.

Feynman kończył swoje przemówienie jedną myślą:

Pierwsza zasada to nie oszukiwać samego siebie. A siebie samego oszukać jest najłatwiej.

Richard Feynman

Warto o tym pamiętać następnym razem, gdy ktoś pokaże ci raport ze stoma wykresami i powie, że wie, jak działa algorytm Google, albo giełda, albo rynek krypto.

Źródła:

Cargo cult science (Feynman)

- Wikipedia: https://en.wikipedia.org/wiki/Cargo_cult_science

- Pełny tekst przemówienia (Caltech 1974): https://people.cs.uchicago.edu/~ravenben/cargocult.html

- Omówienie na The Marginalian: https://www.themarginalian.org/2012/06/08/richard-feynman-caltech-cargo-cult-science/

Problem wielokrotnych porównań

- Wikipedia: https://en.wikipedia.org/wiki/Multiple_comparisons_problem

- Korekta Bonferroniego: https://en.wikipedia.org/wiki/Bonferroni_correction

Survivorship bias

Philip Tetlock – prognozowanie eksperckie

- Wikipedia (sylwetka): https://en.wikipedia.org/wiki/Philip_E._Tetlock

- Wikipedia (książka): https://en.wikipedia.org/wiki/Expert_Political_Judgment

- Good Judgment Project: https://en.wikipedia.org/wiki/The_Good_Judgment_Project

Ioannidis – „Why Most Published Research Findings Are False”

- Wikipedia: https://en.wikipedia.org/wiki/Why_Most_Published_Research_Findings_Are_False

- Oryginał w PLOS Medicine: https://journals.plos.org/plosmedicine/article?id=10.1371/journal.pmed.0020124

Kryzys replikacji w psychologii