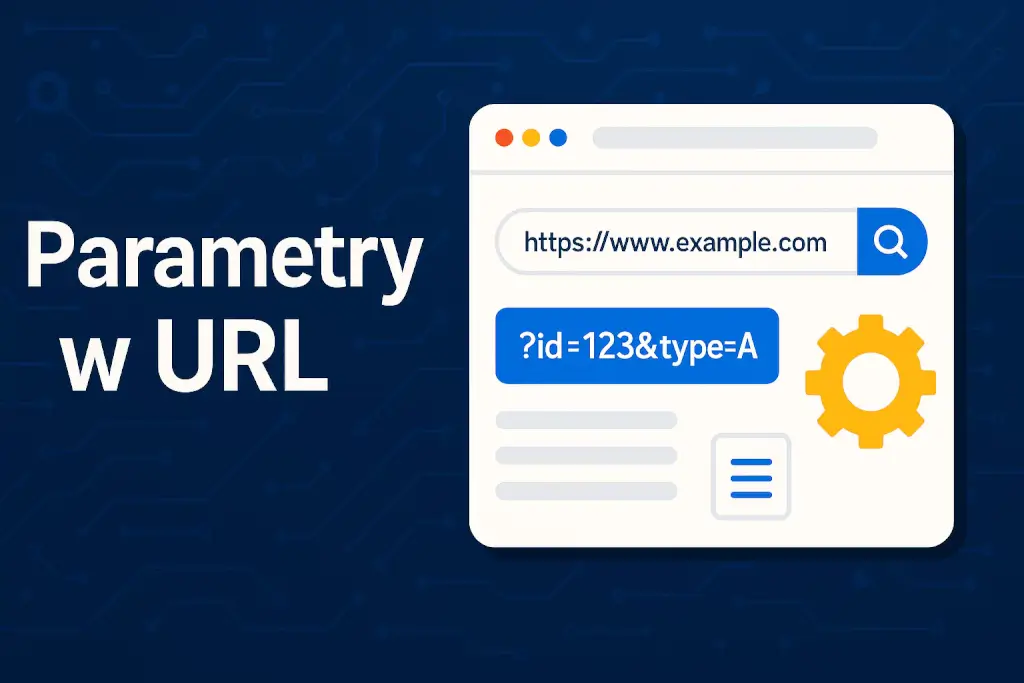

Parametry w URL – kompletny przewodnik SEO

Parametry URL to niezbędny element współczesnego SEO. Są istotne dla tworzenia dobrych doświadczeń na stronach internetowych, szczególnie w e-commerce. Jednak mogą powodować poważne problemy techniczne z SEO, które szkodzą widoczności witryny. Ten przewodnik przedstawia kompletny plan działania – pomoże Ci zrozumieć i zarządzać parametrami URL, abyś mógł wykorzystać ich moc bez ryzyka. Zaczniemy od odpowiedzi na cztery podstawowe pytania.

Czym jest parametr w URL?

Parametr URL, nazywany także query string, to dodatkowe dane dołączone na końcu adresu URL. Dane te informują serwer internetowy, co ma zrobić – na przykład mogą zmienić wyświetlaną treść lub śledzić sposób korzystania ze strony.

Struktura URL z parametrami jest prosta. Query string zaczyna się od znaku zapytania (?), który oddziela go od głównej ścieżki URL. Parametry składają się z par klucz-wartość. „Klucz” określa typ danych, jak „category”, a „wartość” podaje konkretną instrukcję, jak „shoes”. Znak równości (=) łączy klucz z wartością. Możesz dodać więcej parametrów – łączy je znak ampersand (&).

Na przykład, spójrz na ten URL:

https://www.example-store.com/apparel?type=shirts&color=blueCode language: JavaScript (javascript)Oto jego składowe:

Główny URL: https://www.example-store.com/apparel

Parametr 1: type=shirts

Parametr 2: color=blue

To informuje serwer, żeby wyświetlił stronę z odzieżą, ale tylko niebieskie koszulki.

Dlaczego parametry w URL są ważne dla SEO?

Parametrów w SEO mogą wywoływać konflikty. Są niezbędne dla funkcjonowania strony, ale mogą zaszkodzić wydajności w wyszukiwarkach, jeśli są źle stosowane. Z jednej strony umożliwiają kluczowe funkcje – filtrowanie produktów, sortowanie, paginację i śledzenie kampanii marketingowych.

Z drugiej strony wyszukiwarki traktują każdy unikalny URL (czyli z innym parametrem) jako nową stronę. To może prowadzić do poważnych problemów SEO:

- Duplicate Content: Wiele URL-i wyświetla tę samą lub podobną treść.

- Marnowanie Crawl Budget: Boty indeksują tysiące dodatkowych URL-i, omijając wartościową treść Twojej strony.

- Rozwodnienie Link Equity: Głosy rankingowe z linków rozdzielają się między wiele wersji URL-i, osłabiając główną stronę.

Kiedy używać parametrów w URL?

Parametrów powinieneś używać, gdy musisz dynamicznie zmieniać treść strony, unikając tworzenia nowych stron statycznych dla każdej opcji. To się zdarza głównie w dwóch przypadkach:

- Modyfikowanie treści strony:

Obejmuje sortowanie produktów według ceny, filtrowanie wyników według rozmiaru czy koloru, a także paginowane posty na blogu. - Śledzenie aktywności użytkowników:

To kluczowe dla marketingu cyfrowego. Parametry jak kody UTM śledzą, skąd użytkownicy trafiają na stronę, pozwalając na dokładne dane o wydajności.

Jak skutecznie zarządzać parametrami w URL?

Dobre zarządzanie wykorzystuje sygnały techniczne i przemyślane planowanie, prowadząc i informując wyszukiwarki w sposobie indeksowania strony (czyli co indeksować a czego nie). Główny cel to wybranie, które strony są wartościowe dla wyszukiwania, a które to tylko funkcjonalne duplikaty.

Główne rozwiązania obejmują:

- Audyt: Najpierw musisz znaleźć wszystkie parametry i zrozumieć, co robią.

- Kanonizację: Użyj tagu rel=”canonical”, który wskazuje „główną” wersję strony.

- Kontrolę indeksowania: Użyj pliku robots.txt, który powstrzymuje boty przed indeksowaniem URL-i o niskiej wartości.

- Kontrolę indeksu: Użyj meta tagu noindex, który wyklucza określone strony z indeksu.

Ostatecznie obsługa parametrów to zadanie strategiczne. Musisz zbalansować funkcje użytkownika z ograniczeniami wyszukiwarek. Duża strona e-commerce może zablokować wiele parametrów, oszczędzając crawl budget. Mniejsza strona może skupić się na tagach canonical, konsolidując swój link authority. Właściwy wybór zależy od rozmiaru i celów Twojej strony.

Anatomia parametru URL

Aby dobrze zarządzać parametrami, musisz znać ich strukturę i różnicę między parametrami zmieniającymi treść a tymi śledzącymi kliknięcia. Ta wiedza kieruje każdą decyzją SEO.

Rozbijanie składni: klucze, wartości i separatory

Każdy URL z parametrami używa standardowego formatu. Zrozumienie każdej części to pierwszy krok. Rozbijmy typowy URL e-commerce:

https://example.com/products?category=shoes&sort=price-ascCode language: JavaScript (javascript)Główny URL: https://example.com/products

To główny adres strony internetowej – statyczna wersja przed wszelkimi zmianami. Reprezentuje podstawową lub kanoniczną treść.

Znak zapytania (?): Ten symbol to separator. Oznacza koniec base URL i początek query string. URL może mieć tylko jeden znak zapytania w tej roli.

Pary klucz-wartość: category=shoes i sort=price-asc

To serce query string. Każda para ma dwie części:

Klucz: To identyfikator określający rodzaj instrukcji (np. category, sort). Nazywany też zmienną.

Wartość: Podaje konkretne dane dla tego klucza (np. shoes, price-asc).

Znak równości (=): Ten symbol oddziela klucz od jego wartości.

Ampersand (&): Ten znak łączy wiele par klucz-wartość. Nie ma twardego limitu na ich liczbę, ale zachowanie krótkości to dobra praktyka.

Fragment URL (Hash / #): kluczowa różnica

Poza query string istnieje inny symbol. Hash, czyli znak (#), tworzy fragment URL. Kieruje przeglądarkę do określonej części strony, na przykład do nagłówka sekcji.

Tradycyjnie serwery ignorowały hash i jego wartość. Wyszukiwarki też nie indeksowały niczego po nim – to było tylko dla lepszego doświadczenia użytkownika. Jednak nowoczesne strony zmieniły tę rolę. Frameworki JavaScript używają hash do nawigacji – to się nazywa hash-based routing. Pozwala użytkownikom przemieszczać się między „stronami” bez pełnego przeładowania.

Choć wyszukiwarki czasem mogą teraz przetwarzać te URL-e, jest to mniej niezawodne dla indeksowania. Musisz znać różnicę: ? wysyła dane do serwera, # tradycyjnie działa po stronie klienta.

Parametry aktywne vs pasywne: podstawowa różnica

Google dzieli parametry URL na dwa główne typy. Ta różnica jest kluczowa dla wyboru właściwej strategii SEO.

Zrozumienie, czy parametr jest aktywny, czy pasywny, to pierwszy krok. Te dwa typy oczywiście tworzą różne problemy. Parametry pasywne, jak UTM, tworzą idealne duplikaty. Dla nich – cel SEO to połączenie sygnałów rankingowych. Główne narzędzie to tag rel=”canonical”, który mówi wyszukiwarkom, żeby przypisały całą wartość do czystego, głównego URLa.

Parametry aktywne są bardziej złożone. Parametr sortowania jak ?sort=price to prawie duplikat – tag canonical to właściwy wybór. Jednak filtr jak ?category=running-shoes może tworzyć konkretną stronę o wartości wyszukiwania. Może być indeksowana jako samodzielna strona. Parametr tłumaczenia jak ?lang=fr tworzy całkowicie nową wersję strony, która musi być indeksowana. Traktowanie jej jako prostego duplikatu byłoby ogromnym błędem SEO.

Ten pierwszy wybór – aktywny czy pasywny – to kluczowa decyzja.

Szczegółowe spojrzenie na typy parametrów i ich zastosowania

Parametry aktywne (zmieniające treść) w działaniu

Parametry aktywne bezpośrednio zmieniają treść na stronie, często w odpowiedzi na działanie użytkownika.

Filtrowanie i nawigacja facetowa: To bardzo powszechne zastosowanie parametrów aktywnych, popularne na stronach e-commerce. Nawigacja facetowa pozwala użytkownikom stosować wiele filtrów, pomagając zawęzić duży zestaw produktów. Każdy filtr dodaje parametr do URL.

Przykład: Użytkownik chce duże, niebieskie koszulki Nike. URL może wyglądać: …/shirts?brand=nike&color=blue&size=large.

Sortowanie: Parametry sortowania zmieniają kolejność treści na stronie. Nie dodają ani nie usuwają żadnych elementów. Użytkownicy mogą sortować według ceny, popularności lub oceny.

Przykład: Aby zobaczyć najtańsze produkty jako pierwsze, użytkownik dodaje ?sort=price-ascending.

Paginacja: Gdy treść jest za długa na jedną stronę, zostaje podzielona. Parametry paginacji informują serwer, którą stronę wyświetlić.

Przykład: Przejście na drugą stronę kategorii dodaje ?page=2.

Wyszukiwanie wewnętrzne: Zapytanie użytkownika w wyszukiwarce strony często staje się parametrem używanym do tworzenia strony wyników.

Przykład: Wyszukanie „technical seo” może skutkować URL-em: …/search?q=technical-seo.

Tłumaczenie i lokalizacja: Dla globalnych stron parametry mogą wyświetlać treść w konkretnym języku lub dostosowywać ją do określonego regionu.

Przykład: URL może mieć ?lang=fr dla strony francuskiej lub ?loc=de dla Niemiec.

Parametry pasywne (śledzące) w działaniu

Parametry pasywne nie zmieniają treści na stronie. Działają za kulisami, śledząc kliknięcia i dane.

Śledzenie kampanii (UTM): To najczęstszy typ parametru pasywnego. UTM śledzą skuteczność kampanii marketingowych. Używają ich narzędzia jak Google Analytics. Jest pięć głównych UTM, ale trzy są najczęściej używane:

- utm_source: Pokazuje źródło ruchu, jak google lub facebook.

- utm_medium: Pokazuje medium marketingowe, jak cpc lub email.

- utm_campaign: Pokazuje konkretną promocję, jak summer-sale-2024.

Pełny przykład: Kliknięcie z reklamy Facebook może wyglądać: …?utm_source=facebook&utm_medium=cpc&utm_campaign=product-launch.

ID sesji: W przeszłości ID sesji śledziły podróż użytkownika po stronie. Teraz robi się to głównie przez cookies przeglądarki. Używanie ID sesji w URL-ach może tworzyć wiele duplikatów stron.

Przykład: ?sessionid=123xyzabc

ID partnerów: Te parametry używane są w marketingu afiliacyjnym. Śledzą, który partner przysłał odwiedzającego, zapewniając właściwemu partnerowi uznanie za sprzedaż.

Przykład: ?affid=partner-blog-name

Ta tabela podsumowuje typy parametrów, pokazując ich cel i typowe podejście SEO dla każdego – to pomocne narzędzie dla każdego SEO-owca robiącego audyt strony.

|

Kategoria |

Typ |

Cel |

Przykład |

Typowe podejście SEO |

|---|---|---|---|---|

|

Aktywny |

Filtrowanie |

Zawęża treść na stronie |

?color=blue |

Kanonizacja do base URL lub indeksowanie, jeśli filtr to strona o wysokiej wartości |

|

Aktywny |

Sortowanie |

Zmienia kolejność treści na stronie |

?sort=price-asc |

Kanonizacja do base URL |

|

Aktywny |

Paginacja |

Dzieli treść na wiele stron |

?page=2 |

Użyj samoreferencyjnych kanonicznych |

|

Aktywny |

Wyszukiwanie |

Wyświetla wyniki wyszukiwania wewnętrznego |

?q=query |

Noindex i blokada indeksowania przez robots.txt |

|

Pasywny |

Śledzenie |

Śledzi kliknięcia kampanii marketingowych |

?utm_source=google |

Kanonizacja do base URL |

|

Pasywny |

ID sesji |

Śledzi sesję użytkownika |

?sessionid=xyz |

Kanonizacja do base URL; cookies są lepsze |

Parametry w nowoczesnych frameworkach JavaScript (SPA)

Nowoczesne strony często działają jak aplikacje – to są Single Page Applications (SPA). Budowane są z frameworkami jak React, Angular czy Vue. SPA ładują pojedynczą stronę HTML tylko raz, potem JavaScript obsługuje wszystkie zmiany treści.

To tworzy unikalne wyzwanie SEO. SPA używają parametrów do filtrowania czy sortowania treści, ale bez pełnego przeładowania strony. To sprawia, że strona wydaje się szybka dla użytkowników. Jednak wyszukiwarki mogą mieć problemy. Jeśli bot nie może właściwie uruchomić JavaScript, może zobaczyć pustą lub niekompletną stronę – nie zobaczy treści, którą parametr powinien wyświetlić.

Ten problem nazywa się problemem client-side rendering (CSR). Najlepszym rozwiązaniem często jest server-side rendering (SSR). Z SSR serwer wysyła w pełni wyrenderowaną stronę HTML, która już zawiera przefiltrowaną treść. Jest łatwa do indeksowania przez wyszukiwarki.

Dlatego dla SPA zarządzanie parametrami to głębszy problem – to nie tylko kwestia tagów jak rel=”canonical”, ale fundamentalnej architektury strony.

Zagrożenia SEO: jak niezarządzane parametry szkodzą stronie

Parametry to techniczna konieczność dla wielu stron, ale źle zarządzane mogą powodować cztery duże problemy SEO, które ograniczają zdolność rankowania strony.

Duplicate content: mylenie wyszukiwarek

Największy problem z parametrów URL to duplicate content. Wyszukiwarki traktują każdy unikalny URL jako osobną stronę. To znaczy, że następujące URL-e wyglądają jak różne strony dla bota, choć wszystkie pokazują te same sukienki:

https://example.com/dresses

https://example.com/dresses?sort=price

https://example.com/dresses?color=red

https://example.com/dresses?sessionid=xyzCode language: JavaScript (javascript)Gdy wyszukiwarka znajdzie wiele stron z tą samą treścią, myli się. Musi zdecydować, którą stronę pokazać w wynikach wyszukiwania. To może prowadzić do złych rezultatów:

- Kanibalizacja słów kluczowych: Wersje URL-i konkurują ze sobą, osłabiając potencjał rankingowy wszystkich.

- Indeksowanie złych URL-i: Google może zaindeksować zagracony, sparametryzowany URL, szkodząc marce i zaufaniu użytkowników.

- Podział sygnałów rankingowych: Autorytet treści rozdziela się między wiele URL-i, zamiast być skoncentrowany na jednej silnej stronie.

Marnowanie crawl budget: męczenie Googlebota

Wyszukiwarki mają ograniczony crawl budget dla Twojej strony. Pomyśl o tym jak o dziennym budżecie dla Googlebota. Na dużych stronach liczba kombinacji parametrów może być ogromna. Strona z 10 filtrami, każdy z 5 opcjami, może tworzyć miliony URL-i.

Jeśli nie zarządzasz tymi URL-ami, Googlebot marnuje swój budżet, eksplorując niekończące się, niskiej wartości warianty. Rezultat? Crawler może nigdy nie znaleźć Twoich najważniejszych stron – nowych produktów czy kluczowych landing page’y. Ten problem to cichy zabójca dla dużych stron.

Rozwodnienie link equity: rozprzestrzenianie siły zbyt szeroko

Backlinki to kluczowy czynnik rankingowy – jak głosy zaufania dla strony. Idealnie wszystkie te głosy powinny wskazywać na jeden kanoniczny URL.

Jednak parametry URL to rujnują. Jeśli jeden blog linkuje do …/dresses?color=red, a drugi do …/dresses?size=m, siła linkowa się dzieli. Zamiast jednej strony z dwoma głosami masz dwie strony z jednym głosem każda. To znacznie utrudnia głównej stronie rankowanie dla kluczowych fraz.

User experience (UX) i click-through rate (CTR): wyglądanie na nierzetelne

Wpływ parametrów wykracza poza boty na prawdziwych użytkowników. Długie, złożone URL-e z „dziwnymi kodami” wyglądają źle. Mogą być mylące lub niezrozumiałe dla ludzi. Gdy użytkownik widzi wyniki wyszukiwania, prawdopodobniej kliknie czysty URL jak:

https://example.com/womens-dresses/red-summer-dressCode language: JavaScript (javascript)A uniknie skomplikowanego, ale czytelnego URLa dla maszyn:

https://example.com/products.php?cat=2&type=4&id=815&color=redCode language: JavaScript (javascript)To może obniżyć click-through rate (CTR). Niski CTR może sygnalizować wyszukiwarkom, że Twój wynik jest mniej istotny. Te URL-e są też trudne do udostępniania (podyktowania czy przepisania), co zmniejsza zaangażowanie marki i ruch.

Najlepsze praktyki obsługi parametrów URL

Krok 1: Audyt obecnego ustawienia (diagnoza)

Zanim cokolwiek naprawisz, potrzebujesz pełnego audytu. Musisz zrozumieć, jak parametry są używane na Twojej stronie. Niemożliwe jest naprawienie problemu, którego nie zidentyfikowałeś 😉

Krok 2: Wybór rozwiązania (leczenie)

Po audycie stosujesz właściwą poprawkę techniczną. Wybór zależy od parametru i Twojego celu.

Tag canonical (rel=”canonical”):

- Cel: Tag canonical to element HTML w

<head>strony. Informuje wyszukiwarki, że konkretny URL to „główna” kopia. To główne narzędzie do naprawiania duplicate content i konsolidacji link equity. - Kiedy używać: Użyj na każdej stronie będącej duplikatem głównej strony. Na przykład URL-e z parametrami śledzącymi (?utm_source=…) powinny go mieć. URL-e z parametrami sortowania (?sort=price) też. Tag powinien wskazywać na czysty URL.

- Zastrzeżenie: Tag canonical to silna wskazówka, nie reguła. Google nadal będzie indeksować URL niebędący kanonicznym, co oznacza, że nadal używa crawl budget.

Plik robots.txt:

- Cel: Plik robots.txt to tekstowy plik w głównym folderze strony. Daje instrukcje crawlerom internetowym. Jego główna rola tutaj to powstrzymanie botów przed indeksowaniem określonych URL-i.

- Kiedy używać: To najlepsze narzędzie do oszczędzania crawl budget. Dyrektywa Disallow może blokować całe grupy URL-i o niskiej wartości. Na przykład Disallow: /? zablokowałaby wszystkie URL-e z parametrami. To świetne dla stron wyników wyszukiwania wewnętrznego.

- Zastrzeżenie: Blokowanie URL w robots.txt oznacza, że Google nie może go indeksować. Więc Google nigdy nie zobaczy innych sygnałów na tej stronie, włączając tag noindex czy canonical.

Meta tag noindex:

- Cel: To meta tag w HTML

<head>. Mówi wyszukiwarkom, żeby nie umieszczały strony w indeksie. - Kiedy używać: Używany dla stron, do których crawlery mogą mieć dostęp, ale które nie powinny pojawiać się w wynikach wyszukiwania. Dobre przykłady to cienkie przefiltrowane widoki, strony profili użytkowników czy strony logowania.

- Zastrzeżenie: Żeby tag noindex został zobaczony, Google musi zaindeksować stronę. To oznacza, że nadal używa crawl budget. Jest mniej efektywny dla marnowania crawl niż robots.txt.

Przepisywanie URL (statyczne URL-e):

- Cel: Ta zaawansowana metoda używa reguł po stronie serwera. Zamienia dynamiczny, oparty na parametrach URL w czysty, statyczny. To bardziej przyjazne dla użytkowników i SEO.

Przykład:

Reguła serwera może zmienić example.com/products?category=shoes, żeby wyglądał jak example.com/products/shoes/. - Kiedy używać: To najlepsze dla parametrów aktywnych tworzących unikalne strony. Jeśli przefiltrowany widok dla „butów do biegania męskich” ma wystarczająco unikalną treść, to potężna strategia.

Wybór między tymi narzędziami wymaga kompromisów. Ta tabela porównuje główne metody, wyjaśniając ich funkcje, by pomóc w strategicznym wyborze.

|

Rozwiązanie |

Wpływ na indeksowanie |

Wpływ na indeksy |

Konsoliduje link equity? |

Główne zastosowanie |

Zalety |

Wady |

|---|---|---|---|---|---|---|

|

rel=”canonical” |

Nie zapobiega indeksowaniu |

Zapobiega indeksowaniu duplikatów |

Tak |

Konsolidacja prawie-duplikatów |

Konsoliduje sygnały rankingowe |

Marnuje crawl budget |

|

robots.txt Disallow |

Zapobiega indeksowaniu |

Zapobiega nowemu indeksowaniu |

Nie |

Oszczędzanie crawl budget |

Najefektywniejszy sposób oszczędzania budżetu |

Nie konsoliduje sygnałów |

|

Tag noindex |

Nie zapobiega indeksowaniu |

Zapobiega indeksowaniu |

Nie |

Strony, które chcesz indeksować, ale nie w wynikach |

Usuwa strony z indeksu |

Zużywa crawl budget |

Typowe błędy w zarządzaniu parametrami URL (i jak ich unikać)

Błąd 1: używanie parametrów dla głównych stron nawigacyjnych

- Pułapka: Niektóre starsze systemy tworzą URL-e dla głównych stron z parametrami. Na przykład ?page_id=2 dla strony „O nas”. Te URL-e są trudne do czytania i tracą szansę na użycie słów kluczowych.

- Poprawka: Upewnij się, że wszystkie główne, statyczne strony używają czystych URL-i, jak /about-us/. Parametry powinny być tylko dla dynamicznych zmian treści.

Błąd 2: niespójne linkowanie wewnętrzne

- Pułapka: Zły błąd to linkowanie wewnętrzne do różnych wersji strony. Na przykład główne menu linkuje do /dresses, a boczna reklama do /dresses?sort=newest. To myli wyszukiwarki co do głównego URL.

- Poprawka: Miej ścisłą politykę – zawsze używaj czystego, kanonicznego URL dla wszystkich linków wewnętrznych. To mówi wyszukiwarkom, która strona powinna być indeksowana.

Błąd 3: sprzeczność robots.txt i noindex

- Pułapka: Częsty błąd to używanie tagu noindex na stronie, a potem blokowanie tej samej strony robots.txt. Wyszukiwarki słuchają robots.txt pierwszego. Jeśli strona jest niedozwolona, bot nigdy nie zobaczy tagu noindex. Strona może zostać w indeksie.

- Poprawka: Użyj jednego narzędzia albo drugiego. Jeśli chcesz zatrzymać indeksowanie, użyj robots.txt. Jeśli chcesz stronę poza indeksem, zrób ją indeksowalną i użyj noindex.

Błąd 4: stosowanie ogólnego canonical do serii paginowanych

- Pułapka: Ludzie często źle rozumieją kanoniczne. Wstawiają tag canonical na wszystkich stronach paginowanych (page=2, page=3), wskazujący z powrotem na stronę 1. To mówi wyszukiwarkom, że wszystkie strony to duplikaty pierwszej. To może powstrzymać treść z głębszych stron przed znalezieniem.

- Poprawka: Każda strona w serii paginowanej powinna mieć samoreferencyjny tag canonical. Więc …/category?page=2 powinno mieć canonical wskazujący na siebie. To pokazuje, że to unikalna część sekwencji.

Błąd 5: tworzenie nieskończonych przestrzeni URL

- Pułapka: Źle ustawiona nawigacja może tworzyć nieskończone URL-e. Może pozwalać na dodawanie tego samego filtra wiele razy (?color=red&color=blue…). To tworzy „pułapkę pająka” dla crawlerów, marnującą cały crawl budget.

- Poprawka: Użyj logiki po stronie serwera, żeby to zatrzymać. Dla znanych złych wzorców użyj robots.txt do blokowania crawlerów.

Błąd 6: ignorowanie kolejności parametrów

- Pułapka: Dla wyszukiwarki ?color=blue&size=m i ?size=m&color=blue to dwa różne URL-e. Jeśli Twoja strona pozwala na dowolną kolejność, tworzy duplicate content. To dzieli sygnały rankingowe i marnuje crawl budget.

- Poprawka: Pracuj z deweloperami nad skryptem wymuszającym parametry w spójnej kolejności. To zapewnia, że każda kombinacja filtrów zawsze tworzy ten sam URL.

Kluczowe wnioski dla skutecznego zarządzania parametrami

Uznaj dualizm: Parametry są niezbędne dla funkcji strony, ale to duże ryzyko SEO, jeśli nie są dobrze zarządzane.

Znaj zagrożenia: Główne niebezpieczeństwa to duplicate content, marnowany crawl budget i rozwodnione link equity.

Najpierw audytuj, potem działaj: Zawsze zacznij od pełnego audytu. Użyj crawlerów, GSC i plików logów, żeby zrozumieć, jak parametry są używane.

Użyj właściwego narzędzia do zadania:

- Użyj rel=”canonical” do łączenia sygnałów rankingowych i naprawiania duplicate content

- Użyj robots.txt do oszczędzania crawl budget przez blokowanie URL-i o niskiej wartości

- Użyj tagu noindex do trzymania konkretnych stron poza wynikami wyszukiwania

Utrzymuj wewnętrzną spójność: Zawsze linkuj wewnętrznie do czystej, kanonicznej wersji URL.

Opracuj niestandardową strategię: Nie ma jednego idealnego rozwiązania. Najlepszy plan zależy od rozmiaru, platformy i celów SEO Twojej strony.

Najczęściej zadawane pytania (FAQ)

-

Jaka jest różnica między parametrem URL a parametrem UTM?

Parametr UTM to specjalny rodzaj parametru URL. „Parametr URL” to szeroki termin dla każdej pary klucz-wartość w URL. Mogą być do sortowania (?sort=price) lub filtrowania (?color=blue). UTM to standardowy zestaw używany tylko do śledzenia kampanii marketingowych – nie zmieniają treści strony.

-

Czy wyszukiwarki mogą indeksować URL-e z parametrami?

Tak, wyszukiwarki mogą i indeksują URL-e z parametrami. Główny problem nie w tym, że mogą być indeksowane, ale że często są indeksowane bez kontroli. To prowadzi do duplicate content i problemów z crawl budget. Dobra obsługa parametrów kontroluje, które URL-e są indeksowane.

-

Jeśli sparametryzowany URL ma tag canonical, czy ma znaczenie, jeśli ktoś do niego linkuje?

Idealnie wszystkie linki przychodzące powinny wskazywać na czysty URL. Jednak tag rel=”canonical” to silna siatka bezpieczeństwa. Jeśli inna strona linkuje do sparametryzowanego URL (jak …/page?utm_source=xyz), a ta strona ma poprawny tag canonical, Google dobrze przekazuje link equity do kanonicznego URL. Czyste linki są najlepsze, ale kanoniczne pomagają.

-

Czy powinienem po prostu zablokować wszystkie parametry robots.txt używając Disallow: /??

To bardzo agresywna i często zła strategia. Używanie Disallow: /? to potężny sposób oszczędzania crawl budget, ale to tępe narzędzie. Może mieć złe skutki uboczne – może blokować wartościowe strony używające parametrów. Na przykład konkretne przefiltrowane widoki czy przetłumaczone strony. Również powstrzymuje Google przed widzeniem tagów noindex czy canonical. Bardziej ukierunkowane podejście jest prawie zawsze lepsze.